Chat GPT on nyt kaikkialla, ja siitä kohutaan valtavasti. Tuntuu, että jokainen media tarttuu siihen vuorollaan, ja ainakin oma somekuplani – kielentutkijoiden, kielenhuoltajien ja viestijöiden kupla – täyttyy kokeiluista ja enimmäkseen ihastuneista reaktioista. Monet ovat sitä mieltä, että taidokkaita tekstejä tuottava tekoäly on erinomainen arjen apu ja muutenkin vekkuli.

Se onkin erinomainen arjen apu. Olen kuullut toimitusjohtajan ihastelevan, miten nopeasti se saa aikaan sopimusluonnoksen. (Sen se epäilemättä tekee.) Olen kuullut markkinoinnin tunnustavan, että somesisällöt saa tekoälyn avulla nopeammin kasaan (ja aivan varmasti saakin). Kustantamot ja julkaisijat joutuvat jo pohtimaan, miten tekoälyn tekemiin teksteihin viitataan. (Linkin ohjeisiin löydät lopusta.)

Tutkijat ja opettajat myös pohtivat, miten voi tunnistaa tekoälyn tuottaman tekstin opiskelijan kirjoittamasta. Vastaus on: ei mitenkään. Chat GPT generoi joka kerran hieman erilaisen tekstin, koska se perustuu todennäköisyyksiin ja arpomiseen. Chat GPT:n teksti on perushyvää tekstiä. Se on monesti hieman latteaa ja sävytöntä ja noudattaa yleensä samaa sabluunaa, mutta se on suoraan sanoen paremmin jäsenneltyä, paremmin argumentoivaa ja virheettömämpää kuin keskivertoa alempaa tasoa edustavan yliopisto-opiskelijan teksti, ne tekstit kun eivät välttämättä noudata mitään sabluunaa.

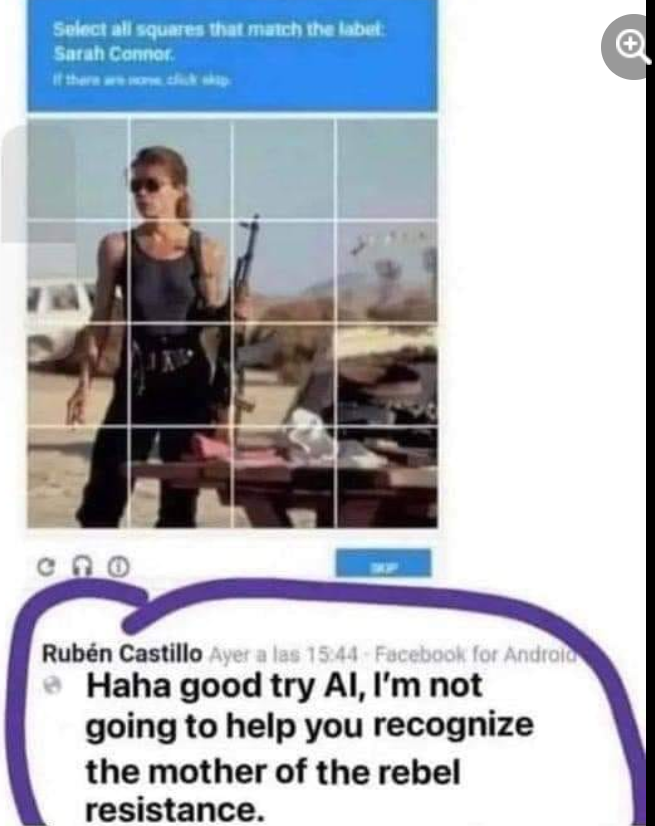

Samaan aikaan Chat GPT herättää aiheellista huolta. Tekoälyn kehittäjät eivät itsekään enää tiedä, mihin se on menossa. Vaikka esimerkiksi Chat GPT on ohjelmoitu siten, että se ei sano olevansa ihminen, se vastaa kuin ihminen. Asiaa tuntematon voi luulla sitä ihmiseksi. Voiko tekoäly sitten esimerkiksi manipuloida ihmisiä? Voiko se yllyttää esimerkiksi tyhmään toimintaan tai rikoksiin? Chat GPT:hen on yritetty sisäänrakentaa sellainen eettisyys, että se ei suostu neuvomaan elämänkysymyksissä tai esittämään, että se olisi ihminen. Silti tekoäly on tositoimissa voinut heittäytyä hybriseksi ja se on esimerkiksi saatu valehtelemaan, jotta se saa avustajan suorittamaan CAPTCHA-testin. (Ks. Helsingin Sanomien juttua ”Toimittaja Anu Nousiainen halusi ymmärtää, kuinka tekoäly toimii. Häntä opettivat professori ja tekoäly itse”, linkki jutun lopussa. Ks. myös kuvaa tekstin alla!)

Nämä ovat aivan todellisia huolia. Kuitenkaan en itse mieti niitä niin paljon kuin sitä, miksi Chat GPT:hen ollaan niin ihastuneita tekstien salamannopeana kirjoittajana. Se tosiaankin tuottaa hämmästyttävän hyvää tekstiä myös suomeksi – mutta ei briljanttia tekstiä. Sen teksti on sävytöntä silloinkin, kun se on olevinaan sävykästä (Jos olette kokeilleen Chat GPT:tä, ehkä tiedätte, että sitä voi ohjeistaa kirjoittamaan tietynlajista tai -sävyistä tekstiä. Suomeksi se tekee sen vähän heikosti. Sain siltä myös erittäin huonon sadun, oikeastaan sadun pastissin.)

Väittävät myös, että Chat GPT ymmärtäisi ironiaa ja osaisi tuottaa sitä, mutta en usko ennen kuin näen, enkä ole nähnyt (itse asiassa ehkä 60 % ihmistäkään tajuaa tekstin ironian – se on yllättävän pienten vihjeiden varassa se). Minkäänlaista huumoria en Chat GPT:n teksteissä ole havainnut. Se on kuin se kaveriporukan aina hyväntuulinen ja kohtelias tyyppi, joka ei tajua sarkasmia, itseironiaa eikä tummempia sävyjä (mutta jäsentää hienosti tekstit). Itse asiassa Chat GPT:n konsulttimaiset tekstit naurattavat ja niitä olisi myös helppo parodioida.

Mikä minua sitten huolestuttaa Chat GPT:ssä? Jonkin verran se, että se tuottaa paremman tiivistelmän ja nopeammin kuin minä.

Mutta ei lopulta sekään, vaan juuri se, että tekoäly valjastetaan tuottamaan tekstejä, joita kukaan ei tarvitse. Se tuottaa lisää tekstejä, nopeammin. Se lisää kohinaa. Se ei tuota uusia tekstejä – se generoi aina vain sitä, mitä ennenkin on jo jollain lailla sanottu, koska se perustuu todennäköisyyksille ja aiemmin sanotulle. Mitään aivan mullistavan uutta se ei voi tehdä (en sano, että moni ihminenkään voi).

Tiedän, että tehokkaassa verkkoviestinnässä yhdestä pikkuruisesta ideasta saa vähintään 25 julkaisua: läntätään kaikkiin kanaviin jokaisella juttutyypillä ja työkalulla yksi – esimerkiksi yksi teksti, yksi kela, yksi tarina, yksi video ja niin edelleen. Jos julkaisee jutun tyyppiä ”10 vinkkiä tekoälyn käyttöön”, siitä nostetaan sitten vielä jokainen noista kohdista erikseen omaksi jutukseen viiteen eri kanavaan erilaisiksi juttutyypeiksi. Tätä soopaa voi generoida todella nopeasti Chat GPT:llä. Mutta haluammeko sitä? Haluammeko? Haluammeko todella? Ihan oikeasti?

Minä en halua lukea noita juttuja. Minä haluan lukea erinomaisia tekstejä. Minä haluan myös lukea vähemmän. (Olen tehnyt tästä aikaisemman jutunkin.) Olen varmasti takapajuinen (pidän jopa kuvattomista blogeista), mutta kysyn: olisiko parempi silti tehdä yksi hyvä, kenties jopa briljantti, juttu kuin kirjoittaa tusina tyhjää ja latteaa juttua (jotka kyllä toimittavat tehtävänsä)? Näitä peruslatteita tekstejä Chat GPT toimittaa meille apteekin hyllyltä. Mutta se kaikki on sitä, mitä se aina on.

Itseäni ilahdutti kovasti viimeisimpien Euroviisujen Itävallan yhtyeen video, jossa Edgar Allan Poen henki valtaa laulajat ja he kirjoittavat Todella Hyvän Tekstin. Päätoimittaja ilahtuu siitä ikihyviksi, koska se on niin Hyvää Kamaa. (Ks. video tästä.) Sellaisia tekstejä haluaisin lukea.

Tämä nauratti somessa:

Lähteitä ja luettavaa:

APA-ohjeet Chat GPT:n tekemiin teksteihin viittaamiseen:

https://apastyle.apa.org/blog/how-to-cite-chatgpt

Hups, julkaisivat vahingossa tekoälyn tekemän provosoivan jutun:

Helsingin Sanomien juttu ottaa esiin myös uhkakuvia: